Bonjour à tous et bienvenue pour un résumé actualisé de l’histoire fascinante de l’informatique !

1. Les Prémices : L’Ère du Calcul Mécanique

L’aventure de l’informatique commence bien avant l’électricité, avec des outils conçus pour aider l’homme à calculer.

Outils manuels anciens

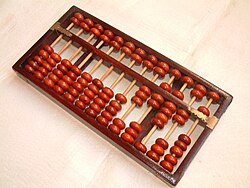

Les premiers instruments incluent des objets simples comme les cailloux, les bouliers et les abaques.

Le boulier est un abaque (outil servant à calculer) formé d’un cadre rectangulaire muni de tiges sur lesquelles coulissent des boules.

Un abaque (du latin abacus, lui-même du grec ancien ἄβαξ / ábax, signifiant « table à poussière »[1], de l’hébreu אבק, avaq signifiant « poussière ») désigne tout instrument mécanique plan facilitant le calcul.https://fr.wikipedia.org/wiki/Abaque_%28calcul%29

Inventions mécaniques

Des avancées plus sophistiquées ont suivi, notamment les bâtons de Neper, la Pascaline (machine à calculer de Blaise Pascal), la machine de Leibniz, et la règle à calcul. Fait intéressant, même le métier à tisser a présenté des principes d’automatisation qui inspireront les futures machines.

Le bâton de Napier, ou réglette de Neper est un abaque facilitant le calcul des produits, quotients, puissances et racines, inventé par le mathématicien écossais John Napier (en français Neper) en 1617.

La pascaline, initialement dénommée machine d’arithmétique puis roue pascaline[1], est une calculatrice mécanique inventée par Blaise Pascal et considérée comme la première machine à calcule

Le calculus ratiocinator est un algorithme ou une machine calculatoire théorique inventé par Gottfried Wilhelm Leibniz et décrit dans son ouvrage De arte combinatoria en 1666

La règle à calcul (ou règle à calculer) est un instrument mécanique qui permet le calcul analogique et sert à effectuer facilement des opérations arithmétiques de multiplication et de division par simple déplacement longitudinal d’un coulisseau gradué.

2. L’Automatisation et les Premiers Ordinateurs Électroniques

La transition vers des machines plus complexes et automatiques a été marquée par des figures et des inventions clés qui ont posé les fondations des ordinateurs modernes.

Les pionniers de l’automatisation

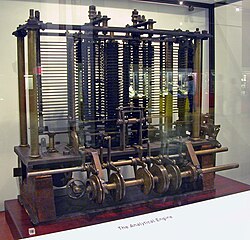

Des figures comme Babbage avec ses machines analytiques, Hollerith et sa tabulatrice, et surtout Alan Turing avec ses concepts théoriques, ont jeté les bases des ordinateurs.

Instructions

Charles Babbage, né le 26 décembre 1791 et mort le 18 octobre 1871 à Londres, est un polymathe, mathématicien et inventeur visionnaire britannique du XIXe siècle qui est l’un des principaux précurseurs de l’informatique.

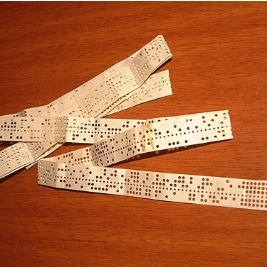

Il est le premier à énoncer le principe d’un ordinateur. En 1834, pendant le développement d’une machine à calculer destinée au calcul et à l’impression de tables mathématiques (la machine à différences), il a l’idée d’y incorporer des cartes du métier Jacquard, dont la lecture séquentielle donnerait des instructions et des données à sa machine, et donc imagine l’ancêtre mécanique des ordinateurs d’aujourd’hui.

Machine lit les instructions

La fin du XIXe siècle connaît le passage « de la mécanique, trop lente et astreignante, à l’électromécanique »[2]. En réponse à un concours lancé par le Bureau américain du recensement, Hermann Hollerith construit une machine à statistiques à cartes perforées qui exploite des cartes

Machine et cryptographie

Alan Mathison Turing, né le 23 juin 1912 à Londres et mort le 7 juin 1954 à Wilmslow, est un mathématicien et cryptologue britannique, auteur de travaux qui fondent scientifiquement l’informatique. Il est aussi un des pionniers de l’Intelligence artificielle

Les premiers ordinateurs électroniques

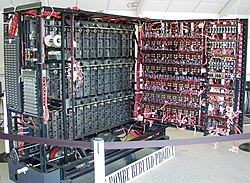

L’ère de l’informatique électronique débute véritablement avec l’apparition de machines comme le Harvard Mark I, le Colossus (utilisé pour le déchiffrage pendant la Seconde Guerre mondiale), et l’Eniac.

L’IBM ASCC (Automatic Sequence Controlled Calculator), appelé le Mark I par l’Université Harvard[1], a été le premier grand calculateur numérique construit aux États-Unis.

Colossus est une série de calculateurs électroniques fondés sur le système binaire. Le premier, Colossus Mark 1, est construit en l’espace de onze mois et opérationnel en décembre 1943

L’ENIAC (acronyme de l’expression anglaise Electronic Numerical Integrator And Computer) est en 1945 le premier ordinateur Turing-complet entièrement électronique. Il peut être programmé pour résoudre, en principe, tous les problèmes de calcul numérique.

3. L’Évolution du Codage de l’Information

Parallèlement au développement matériel, la manière de représenter et de transmettre l’information a connu une évolution cruciale.

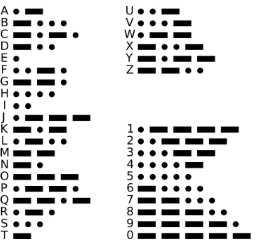

1844 – Le Code Morse : Inventé par Samuel F.B. Morse, il est l’un des premiers codes binaires pour la communication à longue distance.

Les téléscripteurs – Le Code Baudot : Ce code utilisait 5 bits pour représenter jusqu’à 32 caractères différents.

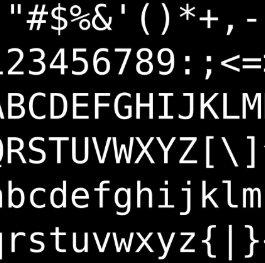

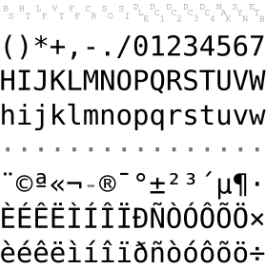

Années 1960 – La standardisation avec l’ASCII : L’American Standard Code for Information Interchange (ASCII) a été adopté, utilisant d’abord 7 bits (128 caractères), puis étendu à 8 bits (256 caractères) pour inclure les accents. À la même époque, IBM développait son propre code sur 8 bits, l’EBCDIC, qui a connu moins de succès.

Vers l’internationalisation : La norme ISO 8859-1 (Latin-1) a étendu le codage pour couvrir plusieurs langues européennes.

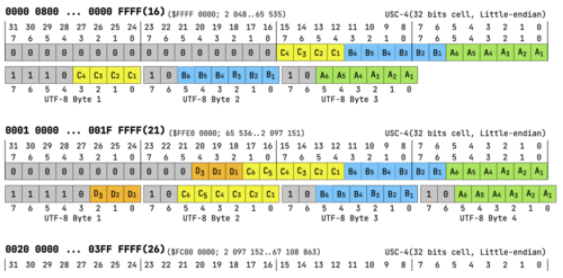

Aujourd’hui – La norme UTF-8 : C’est le codage le plus utilisé sur le web (près de 95,2 % des sites en octobre 2020) et sur les systèmes GNU/Linux. Sa force est sa compatibilité avec l’ASCII et sa capacité à coder l’ensemble des caractères universels.

Codages modernes : L’information est aujourd’hui codée sous de multiples formes, comme les codes QR qui peuvent stocker des URL ou des textes, ou les identifiants de réseaux sociaux qui utilisent des encodages comme ASCII ou Unicode.

4. L’Essor de la Micro-informatique et de la Virtualisation

Les décennies suivantes ont vu l’informatique se démocratiser et les infrastructures se transformer.

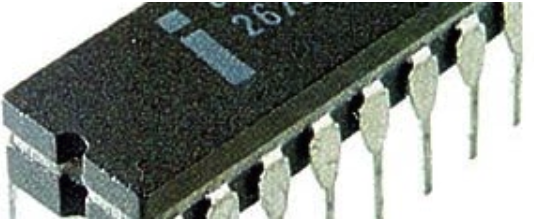

La micro-informatique comprend le matériel en rapport avec les ordinateurs personnels. Ce dernier terme fut introduit par les développeurs du Micral (REE), pour désigner dans leurs brevets le premier ordinateur ayant un microprocesseur comme unité centrale[réf. nécessaire], possibilité ouverte par les progrès en matière de circuits intégrés.

La virtualisation – Origines (années 1960) : Le concept est né pour optimiser l’utilisation des ordinateurs centraux (mainframes), qui étaient coûteux et sous-exploités . L’IBM System/370 a été la première plateforme commerciale conçue pour la virtualisation, permettant d’exécuter plusieurs systèmes d’exploitation simultanément

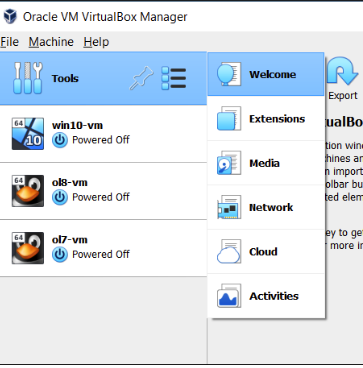

La virtualisation – Popularisation (fin des années 1990 – début 2000) : Des entreprises comme VMware ont rendu la virtualisation logicielle accessible sur les architectures x86

hyperviseurs de type 1 (comme VMware vSphere, KVM) qui fonctionnent directement sur le matériel

hyperviseurs de type 2 (comme VirtualBox) qui s’exécutent sur un système d’exploitation existant comme les logiciels libres comme Xen, QEMU et VirtualBox .

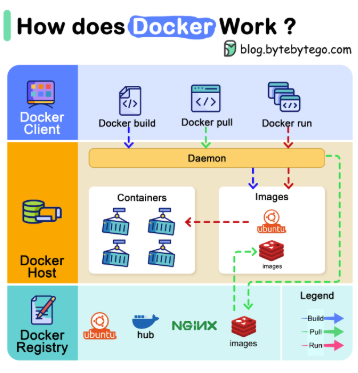

les isolateurs (comme Docker, LXC) qui isolent les applications tout en partageant le noyau du système

5. L’Informatique Contemporaine : Nouveaux Usages et Innovations

L’ère actuelle est marquée par des domaines en pleine expansion qui transforment nos interactions avec la technologie.

L’Intelligence Artificielle (IA) et Humanoid : Elle vise à créer des machines capables de simuler des fonctions cognitives humaines . Les sources soulignent l’importance de son utilisation responsable, en évitant une dépendance excessive qui pourrait limiter l’apprentissage et la créativité . L’honnêteté académique, comme le fait de citer les sources générées par l’IA, est primordiale .

Les Mondes Virtuels : Bien que les termes Réalité Virtuelle (VR) ou Augmentée (AR) ne soient pas explicitement mentionnés, les sources décrivent les mondes virtuels comme des environnements créés par logiciel où des utilisateurs, sous forme d’avatars, peuvent interagir . On les retrouve dans les jeux en ligne (MMORPG) comme World of Warcraft ou les simulateurs comme Second Life .

Les Médias Sociaux : Ils recouvrent une large gamme d’applications basées sur l’interaction et la création de contenu par les utilisateurs, incluant :

◦ Les blogues, microblogues, et flux RSS .

◦ Les wikis collaboratifs comme Wikipédia .

◦ Le partage de photos et de vidéos .

◦ Les réseaux sociaux comme Facebook, Twitter, Instagram, etc. .

◦ Les mashups, qui combinent des contenus de plusieurs sources (par exemple via les API de Google, Amazon, etc.) .

6. Les Enjeux et les Défis Actuels

L’omniprésence de l’informatique soulève des questions critiques liées à la sécurité et à l’impact sur la société.

Dangers liés à l’usage :

◦ Cyberdépendance : Un besoin excessif d’utiliser un ordinateur qui interfère avec la vie quotidienne .

◦ Atteintes à la vie privée : Par exemple, l’utilisation de cookies par Facebook pour pister les utilisateurs, même non-inscrits, à des fins publicitaires .

◦ Droit à l’image et cyberharcèlement .

La Cybersécurité :

◦ Logiciels malveillants : Incluant les virus (qui s’insèrent dans des programmes) , les vers (autonomes sur le réseau comme Morris ou Stuxnet) , les chevaux de Troie, les logiciels espions (spywares) et les hijackers (qui modifient les paramètres du navigateur) .

◦ Autres menaces : Le spam (communications non sollicitées) , les canulars (hoax) , et le phishing (hameçonnage pour voler des informations personnelles) .

◦ Outils de protection : Les pare-feu pour filtrer le trafic réseau , les antivirus qui détectent les menaces via des signatures ou des analyses comportementales , et les anti-spam .

◦ Le Deep Web et le Darknet sont également mentionnés comme la partie du web non indexée par les moteurs de recherche classiques .

7. L’Évolution des Concepts de Programmation

Finalement, l’histoire de l’informatique est aussi celle des langages et des techniques qui permettent de créer des logiciels de plus en plus complexes et interactifs.

En résumé, l’informatique a évolué de simples outils de calcul à des écosystèmes numériques complexes, soulevant sans cesse de nouveaux défis techniques, sociaux et sécuritaires.

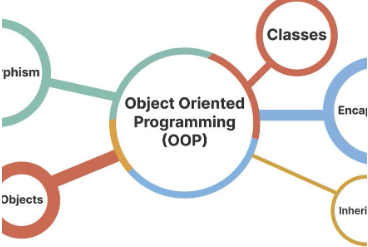

Concepts clés : La programmation moderne s’appuie sur les objets personnalisés, l’héritage, les propriétés et les méthodes pour réduire la taille du code et faciliter sa maintenance .

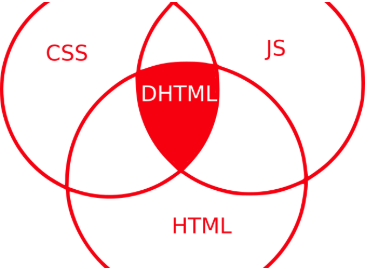

Interactivité web : Le DHTML et JavaScript permettent de créer des pages dynamiques grâce à la programmation événementielle (ex: onclick, onload)

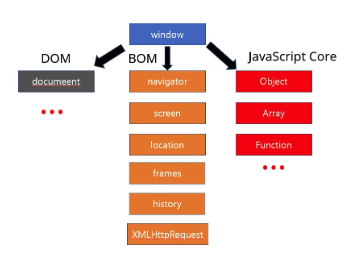

Interaction avec le navigateur et le document : Le BOM (Browser Object Model) permet de manipuler les fenêtres du navigateur , tandis que le DOM (Document Object Model) offre une représentation structurée du document HTML/XML que les scripts peuvent modifier .

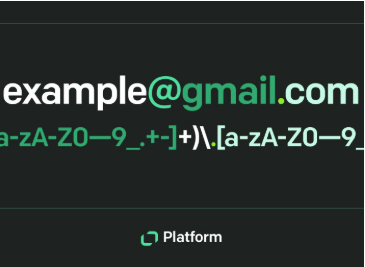

Traitement de texte avancé : Les expressions régulières sont un outil puissant pour rechercher, remplacer ou valider des motifs dans des chaînes de caractères, par exemple pour la validation de formulaires .

Gestion de projet : L’analyse fonctionnelle est une étape essentielle pour définir les utilisateurs, les cas d’utilisation et la structure d’un projet logiciel .

D’où vient le terme « Bug »

Grace Hopper : La Pionnière du Compilateur et du COBOL

Nous allons découvrir l’histoire de Grace Hopper (1906-1992), une femme brillante qui a non seulement programmé certains des premiers ordinateurs au monde, mais qui a aussi changé la façon dont nous communiquons avec eux. Son parcours est une source d’inspiration, marqué par des innovations majeures et des défis personnels importants.

1. Une vie réinventée à 35 ans

Imaginez quitter une carrière stable pour vous lancer dans l’inconnu. C’est exactement ce que Grace Hopper a fait. Avant la Seconde Guerre mondiale, elle était une professeure de mathématiques respectée et innovante à l’Université Vassar. Mais elle sentait que son travail, bien que sécuritaire, ne la mettait plus au défi.

Poussée par le désir de servir son pays et de trouver un nouveau sens à sa vie, elle a pris deux décisions radicales :

• Elle s’est engagée dans la Marine américaine.

• Elle s’est séparée de son mari, dont elle a divorcé quelques années plus tard.

Ce tournant a marqué le début de sa nouvelle vie de pionnière en informatique, un domaine où ses compétences allaient se révéler inestimables.

2. Ses contributions révolutionnaires à l’informatique

Grace Hopper n’était pas seulement une programmeuse ; elle était une visionnaire qui voulait rendre la technologie accessible à tous.

• L’anecdote du « bug » : Une histoire célèbre raconte qu’un jour, son équipe a trouvé la cause d’une panne d’ordinateur : une mite (un insecte) était coincée dans la machine. En la retirant, elle a popularisé le terme « bug » pour désigner une erreur dans un programme.

• L’idée géniale : programmer en anglais : À l’époque, la programmation se faisait avec des symboles mathématiques complexes. Grace Hopper a eu une idée révolutionnaire : le code informatique devait être écrit en anglais. Son objectif était de rendre la programmation plus facile à comprendre et accessible à un plus grand nombre de personnes, pas seulement à une élite de mathématiciens.

• L’invention du compilateur : Pour transformer son idée en réalité, elle a aidé à développer le compilateur. Il s’agit d’un « programme maître » qui traduit automatiquement des instructions écrites en anglais (comme dans un langage de programmation) en code que la machine peut exécuter. Cela permettait de gagner un temps considérable en réutilisant des morceaux de code déjà stockés dans une « bibliothèque ».

• La naissance de COBOL : Grace Hopper est souvent associée au langage COBOL (Common Business-Oriented Language). Les sources clarifient qu’elle n’en a pas été l’unique créatrice, mais qu’il s’agissait d’un processus collaboratif où elle a joué un rôle de leader et de défenseure du projet.

◦ Son propre langage, le FLOW-MATIC, qui utilisait des commandes en anglais, a servi de modèle (« blueprint ») pour COBOL.

◦ Elle a organisé, avec le Département de la Défense et d’autres entreprises, des conférences pour créer un langage standardisé qui fonctionnerait sur différents ordinateurs.

3. Les défis d’une femme dans un monde d’hommes

Le parcours de Grace Hopper a été semé d’embûches, souvent liées à sa condition de femme dans un domaine qui devenait de plus en plus masculin.

• Un environnement de travail toxique : Son premier poste dans la Marine était au laboratoire de Harvard, sous la direction du commandant Howard Aiken. Celui-ci était décrit comme verbalement abusif et obsédé par la hiérarchie, ce qui créait une ambiance de travail très tendue. Grace Hopper devait souvent jouer le rôle de médiatrice entre lui et le reste de l’équipe.

• Un manque de reconnaissance : Bien qu’elle ait été une programmeuse essentielle, son nom n’apparaissait pas directement sur les manuels des ordinateurs Mark I et Mark II. Les noms des membres de l’équipe étaient listés par rang militaire, une forme de discrimination subtile.

• La « masculinisation » de l’informatique : Durant la guerre, de nombreuses femmes étaient programmeuses. Cependant, dans les années 1950, avec la commercialisation de l’informatique, les entreprises ont commencé à réserver ces postes aux hommes. Après le rachat de sa société, de nombreuses programmeuses ont été licenciées, mais Grace Hopper a pu conserver son poste grâce à son expérience, se retrouvant avec une charge de travail accrue.

• Des épreuves personnelles et une santé mentale fragile : Cette période d’incertitude professionnelle a été la plus difficile de sa vie. Elle a fait face à l’isolement et à la solitude. Ses problèmes avec l’alcool sont revenus, elle a été arrêtée et hospitalisée, et a même menacé de se suicider. Une lettre d’un ami de l’époque montre le manque de compassion qu’elle a subi : ses difficultés étaient perçues non pas comme une maladie, mais comme de l’« immaturité » ou une « révolte » contre son rôle social de femme.

4. Son héritage durable

Malgré tout, l’impact de Grace Hopper est immense.

• Elle a standardisé la programmation et a tout fait pour la rendre accessible.

• Sa vision était celle d’un monde où tout le monde pourrait interagir avec un ordinateur.

• Son héritage est célébré chaque année lors de la « Grace Hopper Celebration of Women in Computing« , un événement créé en 1994 pour soutenir et amplifier la voix des femmes dans la technologie.

L’histoire de Grace Hopper nous montre qu’elle était bien plus qu’une simple programmeuse : c’était une visionnaire, une cheffe d’entreprise, une académicienne et une officière de la Marine. Son travail, parfois éclipsé par des géants de la tech comme Steve Jobs ou Bill Gates, a pourtant jeté les bases du monde numérique que nous connaissons aujourd’hui.